Bei der Analyse des größten Trainingsdatensatzes für KI-Bildgenerierung haben BR-Datenjournalistinnen massenweise Informationen gefunden, mit denen sich Personen identifizieren lassen: Gesichter und Namen, Geokoordinaten oder E-Mails, Kontonummern oder beliebige Kombinationen davon.

Der LAION5B-Datensatz, eine Abkürzung für "Large-scale Artificial Intelligence Open Network", übersetzt "groß angelegtes offenes Netzwerk für künstliche Intelligenz", besteht aus fünf Milliarden Links auf Bilder und ihren Beschreibungen im Internet. Er ist zugleich der einzige vergleichbare Trainingsdatensatz für KI-Modelle, der öffentlich zugänglich ist.

- Zum Webspecial: Der Rohstoff für die KI sind wir

Trainingsdaten: Texte und Bilder aus den Netz

Solche Trainingsdatensätze bestehen aus enormen Mengen an Texten und Bildern. Sie liefern den Rohstoff für KI-Systeme, die Bilder generieren, und derzeit von Millionen Menschen auf der Welt benutzt werden. Diese Bildgeneratoren wie Stable Diffusion, Midjourney oder Dall-e von OpenAI funktionieren alle ähnlich: Menschen beschreiben mit kurzen Texteingaben, sogenannten Prompts, welches Motiv auf dem gewünschten Bild zu sehen sein soll.

Die Programme erstellen dann mit Hilfe der Trainingsdaten ein neues Bild, und nicht nur eines, sondern so viele man möchte. Vor wenigen Tagen reichte in den USA eine anonyme Gruppe Klage gegen das KI-Unternehmen OpenAI ein: Sie wirft der Firma unter anderem massenhafte Verletzungen der Privatsphäre vor.

BR-Analyse: Hunderttausende problematische Daten

Eine BR-Analyse zeigt nun für den deutschsprachigen Teil der LAION-Datensätze, dass sich darin für 20 Millionen Bilder Zusatzinformationen finden, sogenannte Exif-Metadaten. Exif steht für "Exchangeable Image File Format" und bezeichnet Informationen, die in den Bilddateien gespeichert sind. Das Aufnahmegerät speichert zum Beispiel zusätzlich zum Bild den Zeitpunkt der Aufnahme, das Modell der Kamera oder den genauen Standort. Solche Positionsangaben können automatisch bei allen Aufnahmen entstehen. Ein Ergebnis der BR-Analyse: Zu 310.000 Bildverweisen im deutschsprachigen LAION-Teil konnte das Team von BR Data den exakten Aufnahmeort auslesen.

Diese Exif-Daten, in denen die Ortsinformationen gespeichert sind, können als "Restinformationen" angesehen werden. Sofern es keine begründeten Argumente gibt, sollen solche Daten nach Meinung des Bundesamts für Sicherheit und Informationstechnik (BSI) vernichtet werden, wenn Dateien weitergegeben werden.

Experte: Verbreitung von Ortsinformationen ist "No-Go"

Für Eike Kleinfeld, tätig beim Hamburger Datenschutzbeauftragten, ist diese massenhafte Verbreitung von Ortsinformationen aus Exif-Metadaten ein No-Go, sofern es sich um sensible Informationen handelt, die einen Rückschluss auf natürliche Personen erlauben: "Die absolute Zahl ist natürlich hoch problematisch, wenn man sich vergegenwärtigt, dass da Millionen Bilder mit solchen Informationen liegen." Schuhmann von LAION war sich bisher des Problems nicht bewusst: "Auf das Problem werden wir jetzt das erste Mal hingewiesen."

Zu den betroffenen Bildern gehört etwa das Nacktbild eines Niederländers, in der Bildbeschreibung steht ein Vor- und Nachname. Sucht man nach dem Ort, der sich durch die Koordinaten ergibt, zusammen mit dem Namen, ist der Mann schnell identifiziert.

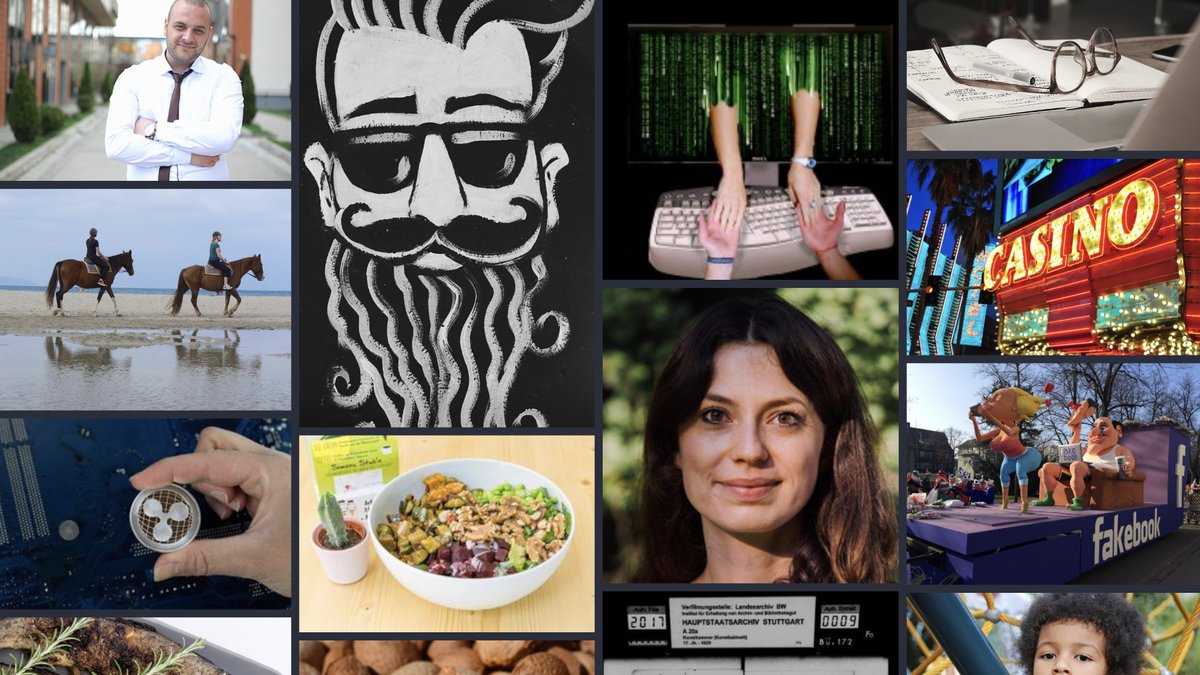

Bilder aus dem LAION-Trainingsdatensatz

LAION zeigt sich transparent

LAION ist ein Zusammenschluss von Freiwilligen aus Europa und Nordamerika. Zu den Gründern gehört Christoph Schuhmann, von Beruf Informatik-Lehrer in Hamburg. Er sagt dem BR: "Wir haben LAION aus Begeisterung für diese KI-Technologie gegründet und dem Wunsch, dass das demokratisiert wird und es am Ende nicht nur zwei, drei großen Firmen gibt."

Die Methode der radikalen Transparenz unterscheidet LAION von der Konkurrenz wie Microsoft, Google, Midjourney oder OpenAI. Über deren Trainingsmaterial und Methodik ist wenig bekannt. Die vier Unternehmen ließen Fragen des BR, wie Trainingsdaten zusammengesetzt und verwendet werden, unbeantwortet. Will man die Lieferkette von populären KI-Bildgeneratoren untersuchen, sind LAIONs Datensätze, Modelle und Werkzeuge aktuell die einzige Möglichkeit - für Wissenschaftler und Wissenschaftlerinnen sowie Journalisten und Journalistinnen.

EU-Gesetzgebung nimmt Trainingsdaten in den Blick

Mehr Transparenz in Sachen Trainingsdaten sieht die EU in der geplanten Gesetzgebung zur Künstlichen Intelligenz vor, dem sogenannten AI Act. Unklar ist aber, wie genau die künftigen Regelungen aussehen sollen. Was jedoch klar ist: Eine Menge Interessensgruppen versuchen, auf die Gesetzgebung einzuwirken: OpenAI, Google und Microsoft lobbyieren für eine Regulierung nach ihren Vorstellungen.

Auch LAION schaltete sich mit einem offenen Brief in die Debatte ein. Derzeit wird noch verhandelt: "Was im AI Act stehen wird, ist in Teilen noch offen. Momentan ist ein wichtiges Diskussionsthema, ob generative KI als Hochrisikogruppe gewertet und reguliert wird", sagt Sandra Wachter, Professorin am Oxford Internet Institute. Bis Ende des Jahres sollen die EU-Regeln stehen und 2025 in Kraft treten. Bis dahin laufen die Systeme weiter wie bisher.

Das ist die Europäische Perspektive bei BR24.

"Hier ist Bayern": Der BR24 Newsletter informiert Sie immer montags bis freitags zum Feierabend über das Wichtigste vom Tag auf einen Blick – kompakt und direkt in Ihrem privaten Postfach. Hier geht’s zur Anmeldung!