Mobbing-Filter Wie Instagram seine Community freundlicher machen will

Hasenöhrchen, Schlafmasken, Boomerangs, Superzooms, … Vor lauter Funktionen und Filtern verliert man bei Instagram mittlerweile fast den Überblick. Jetzt hat die Plattform einen neuen Filter entwickelt – und der hat mal so gar nichts mit Bildbearbeitung zu tun.

Den Instagram-Chefs gefällt ihre Community nicht mehr: Zu viel Mobbing, zu viele Shitstorms, zu viel Body Shaming. Vor allem junge Influencerinnen werden häufig kritisiert und sogar beschimpft, wenn sie irgendwelchen Schönheitsidealen nicht entsprechen. "Wir dulden kein Mobbing bei Instagram. Das vergiftet die Atmosphäre", schimpft CEO Kevin Systrom und geht jetzt aktiv gegen Hater vor. Gerade die jungen Nutzer sollen sich endlich wieder wohlfühlen in ihrem Netzwerk.

Die Lösung: Ein neuer Filter. Ausnahmsweise aber mal keiner, der mit Bildbearbeitung zu tun hat, sondern einer, der Hasskommentare automatisch herausfiltert und verbirgt. Haters gonna hate gilt ab jetzt also nicht mehr so einfach auf Instagram.

"Wir glauben, dass maschinelles Lernen hilft, um die Community integrativer und freundlicher zu machen. Unsere Arbeit diesbezüglich ist noch lange nicht am Ende oder perfekt, aber ich hoffe, Ihr fühlt Euch dadurch sicherer und willkommener auf Instagram."

- Kevin Systrom, CEO & Mitgründer von Instagram

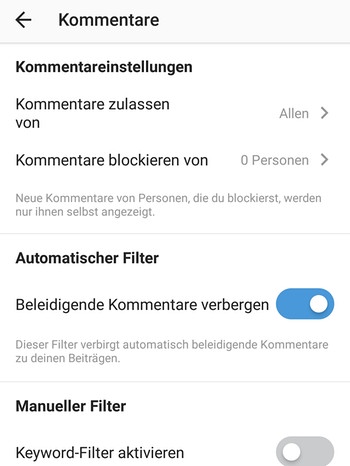

In der Instagram-App ist die Funktion oben rechts im Profil in den Einstellungsoptionen versteckt – unter dem Punkt "Privatsphäre und Sicherheit" bei den "Kommentareinstellungen". Der automatische Filter, der beleidigende Kommentare verbirgt, ist standardmäßig schon aktiviert. Zusätzlich gibt es noch die Option, einen manuellen Filter auszuwählen, der nur Kommentare verbirgt, die bestimmte Keywords enthalten.

Jeder neu gepostete Kommentar fließt ab jetzt erstmal durch ein so genanntes Control Center bevor er unter dem Beitrag selbst erscheint. Anders als bei Plattformen, wie Facebook und Youtube sitzen in diesem Control Center aber keine Mitarbeiter, die sich die Kommentare durchlesen und checken – bei Instagram übernimmt das ein Algorithmus. Der läuft automatisch und verbirgt beleidigende Kommentare. Wird ein Account häufiger auffällig durch Hetzkommentare, kann Instagram diesen User darüber auch direkt sperren.

Ab wann ein Kommentar als beleidigend eingestuft wird, weiß außer dem Instagram-Algorithmus aber keiner so genau. Deshalb werfen einige User der Plattform und ihrem neuen Filter auch Zensur und Manipulation vor.

Welcome to “Instanazi”

— A Patriot Lawman (@HashTagDB) 16. Mai 2018

Der Mobbing-Filter greift übrigens nur dann, wenn der User seinem Hater nicht folgt. Dabei ist es egal, ob der Hater seinem "Opfer" folgt oder nicht – der Filter verbirgt den kritischen Kommentar gegenüber allen, außer dem Hater selbst. Für den sieht es so aus, als sei der Kommentar ganz normal gepostet worden. Für alle anderen ist es, als hätte es den Kommentar nie gegeben.

Sobald ein User allerdings seinem Hater folgt, reagiert der Filter nicht mehr – auch nicht auf offensichtliche Beleidigungen. Der User erhält wie immer eine Benachrichtigung, dass er einen neuen Kommentar erhalten hat und der Kommentar ist für alle sichtbar – auch rückwirkend, also wenn die Kommentare bereits vor einiger Zeit gepostet wurden. Gefilterte Kommentare werden von Instagram nicht per se gelöscht, sie werden immer nur verborgen.

Mit diesem neuen Mobbing-Filter wird der Hass bei Instagram also nicht unbedingt weniger – wir bekommen ihn nur weniger zu sehen. Das kommt der Idee einer freundlicheren Community, wie Gründer Kevin Systrom sie sich vorstellt, offensichtlich derzeit am nächsten.

Sendung: Filter vom 17.05.2018 ab 15 Uhr