Durch das Internet haben mehr Menschen die Möglichkeit sich – auch reichweitenstark – zu äußern: Ein Gewinn für die Meinungsfreiheit, sagen auch Experten. Trotzdem wird immer wieder der Vorwurf der Zensur gegen die Plattformbetreiber von YouTube, Facebook und Twitter erhoben. Vor der Bundestagswahl rolle eine “Welle der Zensur” durch soziale Netzwerke, heißt es auf einem Corona-skeptischen Blog. Auch Personen, deren Posts oder sogar Accounts gelöscht worden sind, beklagen häufig eine "Zensur".

Wie steht es also um die freie Meinungsäußerung im Netz – insbesondere auf Social Media-Plattformen? Der zweite Teil der #Faktenfuchs-Recherche zur Meinungsfreiheit in Deutschland.

Im ersten Teil der Recherche klärt der #Faktenfuchs, ob es in Deutschland Zensur durch den Staat gibt.

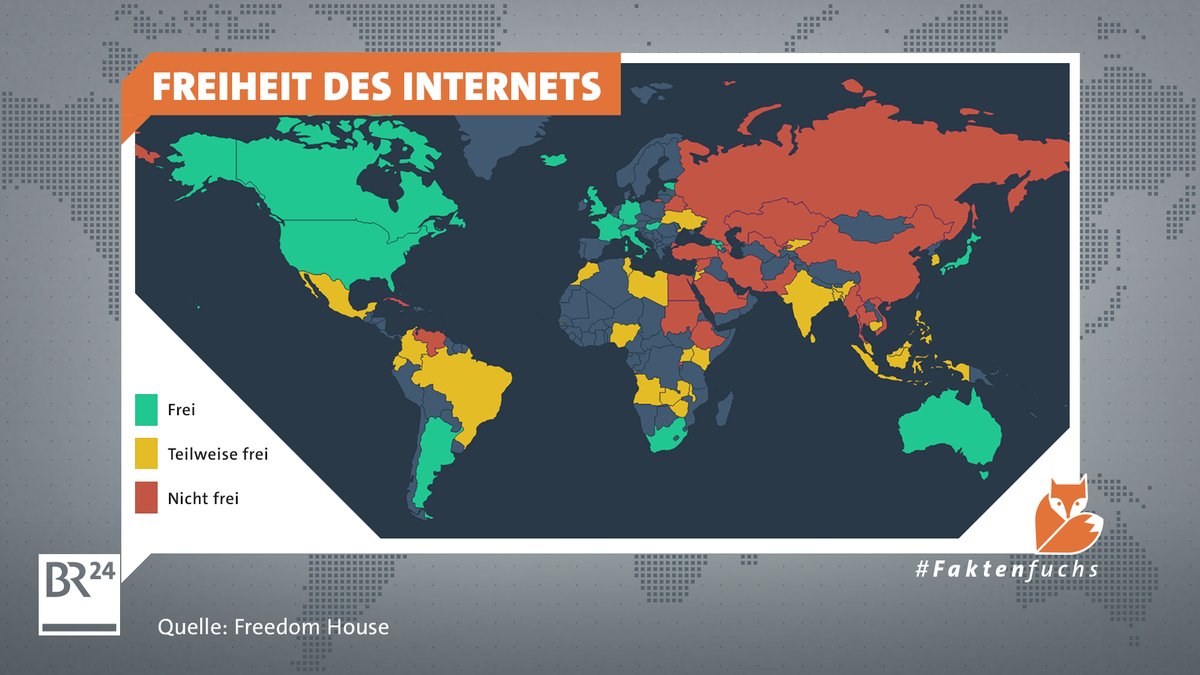

Die internationale NGO "Freedom House" kommt in ihrem jährlichen Bericht "Freedom of the Net" für 2020 zu dem Schluss, dass die Pandemie digitale Repressionen weltweit verstärkt. "Die Corona-Pandemie beschleunigt einen dramatischen Rückgang der globalen Internetfreiheit", heißt es. 26 der untersuchten 65 Länder weltweit hätten im vergangenen Jahr eine Verschlechterung der Internetfreiheit erlebt. Regierungen hätten die Pandemie genutzt, um den Zugang zu Informationen zu limitieren, unabhängige Nachrichtenseiten zu blockieren und die Überwachung auszubauen.

Freiheit des Internets

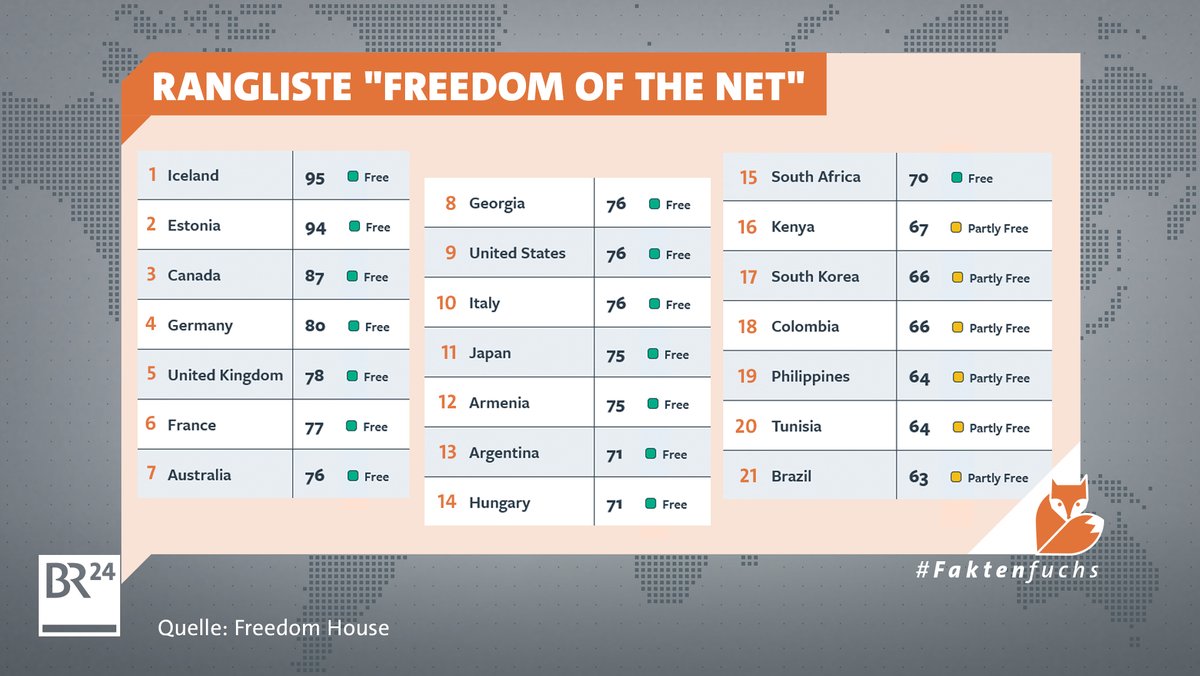

Deutschland stand im Ländervergleich 2020 genauso gut da wie vor der Pandemie. Auf der Internetfreiheits-Skala von "Freedom House" erreicht Deutschland 80 von 100 Punkten – ab 70 Punkten stuft "Freedom House" das Internet als frei ein.

Rangliste "Freedom of the Net"

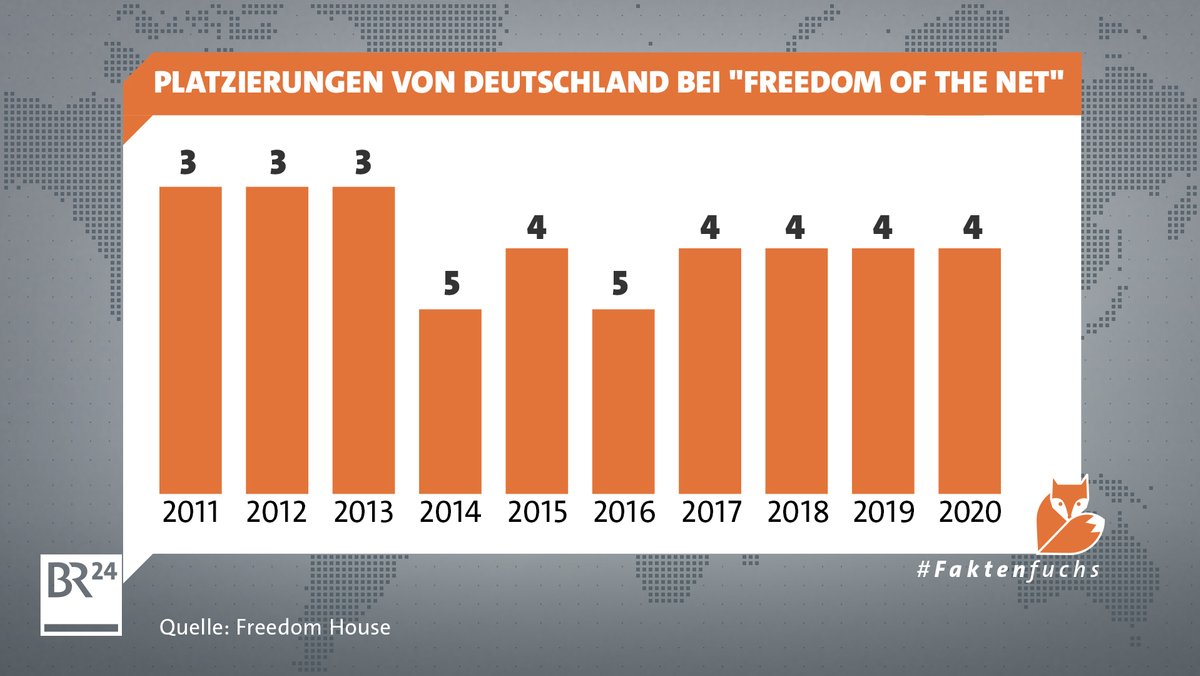

Bis 2014 war Deutschland einige Jahre auf Platz 3, dann mal auf Platz 5 und nun schon einige Jahre auf Platz 4. Aber man muss dazu sagen: Die Platzierung ist auch davon abhängig, ob sich die Lage in anderen Ländern verbessert oder verschlechtert. Es kann also sein, dass Deutschland einen Platz nach oben oder unten wandert ohne dass sich die Lage verändert hätte.

Platzierung von Deutschland bei "Freedom of the Net"

Konkret bezieht der Bericht drei Faktoren ein: Die Hürden des Internetzugangs, Beschränkungen der Inhalte und Verletzungen von Userrechten. Bei der Beschränkung der Inhalte kommt Deutschland im Bericht 2020 auf 30 von 35 Punkten. Abzug gab es unter anderem wegen der Löschpflichten, die der Gesetzgeber den großen sozialen Netzwerken in Bezug auf strafbare Inhalte auferlegt hat – und zwar mit dem Netzwerkdurchsetzungsgesetz, kurz NetzDG.

Das Netzwerkdurchsetzungsgesetz (NetzDG) – Zensur?

Das NetzDG zielt darauf, "Hasskriminalität, strafbare Falschnachrichten und andere strafbare Inhalte auf den Plattformen sozialer Netzwerke wirksamer zu bekämpfen", wie es auf der Seite des Bundesjustizministeriums heißt. 2015 veranlasste der immer stärker aufkommende Hass im Netz den damaligen Bundesjustizminister Heiko Maas eine Taskforce mit Internetanbietern und zivilgesellschaftlichen Organisationen zu gründen, deren Auftrag es war einen effektiven Umgang mit Hassbotschaften zu finden. Er stellte damals besonders "fremdenfeindliche und rassistische Hassbotschaften" heraus. Weil eine Selbstverpflichtung der Plattformbetreiber nicht ausreichte, hat das Bundesjustizministerium am 1. Oktober 2017 das NetzDG eingeführt.

Es verpflichtet soziale Netzwerke dazu, ein Beschwerdeformular für rechtswidrige Inhalte anzubieten. Rechtswidrig sind nach NetzDG Inhalte, die gegen 21 Paragraphen des Strafgesetzbuches verstoßen, zum Beispiel Beleidigung, üble Nachrede, Verleumdung, öffentliche Aufforderung zu Straftaten, Volksverhetzung, Gewaltdarstellung und Bedrohung. Außerdem sind die Netzwerke verpflichtet, rechtswidrige Inhalte zu löschen.

Das NetzDG unterscheidet hier zwischen offensichtlich rechtswidrigen Inhalten und rechtswidrigen Inhalten. Offensichtlich rechtswidrige Inhalte – zum Beispiel ein Hakenkreuz – müssen innerhalb von 24 Stunden nach Eingang der Beschwerde entfernt oder gesperrt werden. Andere Inhalte, die rechtswidrig sind, müssen in der Regel innerhalb von sieben Tagen nach Eingang der Beschwerde entfernt oder gesperrt werden. Tun die Netzwerke das nicht, droht ihnen ein Bußgeld von bis zu fünf Millionen Euro. Zudem müssen die sozialen Netzwerke halbjährlich einen Transparenzbericht vorlegen, in dem sie unter anderem das Beschwerdeverfahren, die Anzahl der Beschwerden und der daraufhin gelöschten Inhalte dokumentieren müssen.

Eine Zensur im rechtlichen Sinne sei das nicht, sagt Marc Liesching, Medienrechtsprofessor an der Hochschule für Technik, Wirtschaft und Kultur Leipzig (HTWK). "Das Verfassungsrecht versteht unter Zensur nur eine behördliche Vorzensur, also dass Publikationsorgane oder Anbieter ihre Inhalte vorlegen müssen bei einer Behörde. Das liegt natürlich nicht vor." Allerdings spricht Liesching, der im März 2021 die Studie "Das NetzDG in der praktischen Anwendung" veröffentlicht hat, von einer "Art zensurgleichen Wirkung" durch das NetzDG. Und zwar dadurch, "dass der Gesetzgeber die großen sozialen Netzwerke sehr eng an die Kandare nimmt, indem er ihnen sehr strenge Löschpflichten in Bezug auf strafbare Inhalte vorsetzt und sie dazu zwingt, eine Lösch-Compliance zu implementieren, die möglichst ökonomisch ist und auch möglichst alles abschöpft, was rechtswidrig ist", wie er dem #Faktenfuchs sagte.

Wer Zensur nur als Löschung von Inhalten aufgrund staatlicher Maßnahmen sehe, mache es sich zu einfach, sagt Chan-Jo Jun, IT-Anwalt aus Würzburg, im Gespräch mit dem #Faktenfuchs. "Unter Zensur versteht man mittlerweile die Löschung von Inhalten, von Meinungen oder von der Ausdrucksform einer Meinung. Und das gibt es."

Kritik am NetzDG

Das NetzDG ist international nicht unumstritten. Ein Bericht der UN von 2019 nennt als Problem des NetzDG: Das Gesetz definiere grundlegende Begriffe wie "Aufstachelung zu Straftaten" und "Hass" nicht. Trotzdem würden Unternehmen erhebliche Geldstrafen auferlegt, wenn sie sich nicht an das Gesetz hielten. Das NetzDG sei "problematisch vage".

Die dänische NGO Justitia, die sich für Freiheitsrechte und Rechtsstaatlichkeit einsetzt, sieht im NetzDG einen "Prototypen für globale Online-Zensur". Einem Justitia-Bericht zufolge haben 20 Staaten und die EU nach dem Vorbild des NetzDG ähnliche Gesetze erlassen, darunter auch Staaten wie Russland, Belarus und Vietnam, die der Freedom of the Net Report als "nicht frei" einstuft. Die meisten der im Bericht erwähnten Staaten hätten sich bei der Rechtfertigung dafür, dass sie die Meinungsfreiheit im Netz gesetzlich eingeschränkt haben, explizit auf das NetzDG bezogen, heißt es in dem Bericht.

Auch der Freedom of the Net Report 2021 stellt fest, dass das NetzDG "von rückständigen Demokratien und autoritären Regimen nachgeahmt und missbraucht wurde, um Anbieter sozialer Medien zu zwingen, LGBT+-Inhalte und investigativen Journalismus zu entfernen".

Marc Liesching sieht es ähnlich: "Das NetzDG, was von Heiko Maas [der 2017 noch Bundesjustizminister war] damals als Exportschlager angepriesen worden ist, war nur ein Exportschlager in autokratische Systeme", sagt Liesching im Gespräch mit dem #Faktenfuchs - und erwähnt als weiteres Beispiel die Türkei, die ebenfalls in dem Justitia-Bericht aufgeführt ist.

In der EU gibt es zum Beispiel noch in Österreich und in Frankreich Gesetze gegen Hass im Netz, die auch Auswirkungen darauf haben, was im Netz gesagt werden darf und was nicht. Um einen Flickenteppich zu vermeiden, gibt es auf EU-Ebene Bestrebungen, einheitlich festzulegen, wie Plattformen gegen die Verbreitung illegaler Inhalte vorgehen sollen. Das soll im Rahmen des Digital Services Act erfolgen, über den aber noch verhandelt wird. Ein Knackpunkt dabei ist die Frage, ob es starre Löschfristen geben soll – wie Deutschland das fordert – oder nicht.

Netzwerke prüfen zuerst nach eigenen Richtlinien

Nach dem NetzDG können Nutzer der Plattformen Inhalte melden, die zum Beispiel beleidigend sind. Die Plattformen sind dann in der Pflicht, sich mit dem gemeldeten Inhalt zu befassen. Bevor YouTube, Facebook und Twitter prüfen, ob ein gemeldeter Inhalt gegen einen im NetzDG aufgeführten Straftatbestand verstößt, prüfen sie zuerst, ob der gemeldete Inhalt gegen die eigenen Richtlinien verstößt.

Die Community-Richtlinien von YouTube untersagen zum Beispiel gewaltverherrlichende oder gefährliche Inhalte. Im Hinblick auf die Meinungsfreiheit ist hier der Punkt "Hassrede" besonders relevant: So entfernt YouTube Inhalte, die in Bezug auf Merkmale wie Nationalität, Rasse, ethnische Herkunft oder sexuelle Orientierung zu Gewalt oder Hass gegen Einzelpersonen oder Gruppen aufrufen. Ähnliches steht in den Gemeinschaftsstandards von Facebook. Auch unter den Regeln und Richtlinien von Twitter gibt es eine “Richtlinie zu Hass schürendem Verhalten”.

Diese Richtlinien seien das "virtuelle Hausrecht" der sozialen Netzwerke, sagt IT-Anwalt Chan-Jo Jun.

Im ersten Halbjahr 2021 hat YouTube 98,2 Prozent der entfernten Inhalte wegen Verstößen gegen die Community-Richtlinien entfernt (die meisten wegen Hassrede oder politischem Extremismus) und nur 1,2 Prozent wegen eines Verstoßes gegen das NetzDG. Das liegt daran, dass die Richtlinien der Plattform – wie auch bei den anderen – inhaltlich weiter gefasst sind als die 21 im NetzDG erwähnten Straftatbestände.

Bei Facebook ist das Verhältnis ähnlich: Im ersten Halbjahr 2021 wurden von den 11.699 gelöschten oder gesperrten Inhalten laut Transparenzbericht 91 Prozent wegen eines Verstoßes gegen die weltweiten Gemeinschaftsstandards gelöscht und nur neun Prozent wegen eines Verstoßes gegen eine im NetzDG aufgeführte Bestimmung des deutschen Strafgesetzbuchs.

Bei Twitter wird zwar wie bei YouTube und bei Facebook jede NetzDG-Beschwerde erst auf einen Verstoß gegen die Regeln und Richtlinien überprüft und gegebenenfalls entfernt. Die verbleibenden Inhalte werden dann hinsichtlich des NetzDG überprüft. Laut Twitter-Transparenzbericht wurden im ersten Halbjahr 2021 zehn Prozent der gemeldeten Inhalte gelöscht oder gesperrt. Wie viele Löschungen/Sperrungen nach den Twitter-Regeln und wie viele nach NetzDG erfolgten, geht aus dem Bericht nicht hervor. Nur bei den drei Straftatbeständen zur Bildung krimineller Vereinigungen (§§ 129 und 129a) sowie zur Verbreitung, Erwerb und dem Besitz kinderpornographischer Inhalte (§ 184b) macht der Transparenzbericht genaue Angaben: Hier wurden in 93,2% der entfernten Inhalte wegen eines Verstoßes gegen die Twitter Regeln und Richtlinien gelöscht und 6,8% wegen einer Verletzung des NetzDG.

Medienrechtler Liesching kommt in seiner im März 2021 veröffentlichten Studie "Das NetzDG in der praktischen Anwendung" zu dem Schluss, dass das NetzDG nur eine geringe praktische Bedeutung hat. Die Restriktionen des NetzDG, speziell enge Löschfristen und hohe Bußgelder würden dazu führen, dass die sozialen Netzwerke verstärkt in ihre eigenen Löschstrukturen ausweichen würden. Da erst die Prüfung nach den eigenen Richtlinien und dann nach den NetzDG-Normen erfolge, liefen die NetzDG-Normen ins Leere.

Kritiker: NetzDG führt zu "Overblocking"

Liesching ist der Ansicht: Das NetzDG führe dazu, dass Netzwerke Inhalte im Zweifelsfall lieber löschen, um mögliche Bußgelder zu vermeiden. Dieses Vorgehen wird als "Overblocking" bezeichnet. Liesching hat in seiner NetzDG-Studie mehrere Anhaltspunkte dafür gefunden. 90 Prozent aller Löschungen bzw. Sperrungen würden innerhalb von 24 Stunden erfolgen. Diese kürzere Frist muss laut NetzDG nur bei offensichtlich rechtswidrigen Inhalten eingehalten werden. Für die sorgfältige Prüfung von Inhalten, die nicht offensichtlich rechtswidrig sind, haben die Plattformen sieben Tage Zeit für eine Prüfung. Diese Frist wird aber laut Liesching aber fast nicht in Anspruch genommen. Auch die Tatsache, dass es wegen Verstößen gegen das NetzDG bislang nur in Einzelfällen Bußgelder gegen die sozialen Netzwerke gegeben habe, wertet Liesching als Indiz für Overblocking. Und das – so seine Argumentation – wäre dann im Hinblick auf die Meinungsfreiheit problematisch.

Das sieht auch Carsten Reinemann, Professor für Kommunikationswissenschaft an der LMU München so. Im Netz legten Internetunternehmen eigene Maßstäbe an, die strenger seien als die des Staats.

Auch IT-Anwalt Jun sieht das Overblocking im Gespräch mit dem #Faktenfuchs kritisch: "Wir müssen das Overblocking dort bekämpfen, wo die Plattformbetreiber von ihrem Hausrecht Gebrauch machen und strenger sind als die gesetzlichen Vorgaben." Manchmal löschten die Netzwerke Inhalte, die von der Meinungsfreiheit gedeckt sein sollten. Gegen diese "überschießenden Löschtendenzen" müsse die Rechtssprechung vorgehen, so Jun.

Die Plattformen tragen maßgeblich zur Meinungsbildung bei, sagt Wolfgang Kreißig, der Vorsitzende der Direktorenkonferenz der Landesmedienanstalten in Deutschland. Die Medienanstalten haben auch eine Kontrollfunktion gegenüber den Plattformen.

Dass Plattformen Meinungen, die vom Grundrecht der Meinungsfreiheit gedeckt sind, auf Grundlage ihrer Geschäftsbedingungen unterbinden, sei "schwierig". Hier sei der Gesetzgeber gefragt, die entsprechenden Rahmenbedingungen festzulegen, sagte er dem #Faktenfuchs.

Facebook löscht zig Millionen Inhalte wegen Verstößen gegen Hassrede-Richtlinie

Die gelöschten Inhalte, die die Netzwerke in ihren Transparenzberichten nach dem NetzDG ausweisen, sind aber nur die Spitze des Eisbergs. Allein im ersten Halbjahr 2021 hat Facebook nach eigenen Angaben 56,7 Millionen Inhalte weltweit als Hassrede eingestuft und in der Folge gelöscht oder gesperrt. Im ersten Halbjahr 2018 waren es noch fünf Millionen, der Wert ist seitdem kontinuierlich gestiegen. Facebook hat "knapp 98 Prozent der Inhalte, die gegen die Hassrede-Richtlinie verstoßen, entfernt, noch bevor Nutzer*innen sie melden konnten – 2017 lag diese Quote noch bei 24 Prozent", wie eine Sprecherin dem #Faktenfuchs mitteilt. Diese "Erkennung" erfolgt teilweise automatisiert, Facebook nennt die dahinter stehenden Algorithmen “proaktive Erkennungsrate”. Marc Liesching bezeichnet die stark gestiegene Quote an automatisiert gelöschten Inhalten als "vorauseilenden Gehorsam, dass gar keine Beschwerden kommen" – und als ein weiteres Indiz für Overblocking: "Diese Effektivierung von Löschung, die wir in den letzten Jahren erlebt haben, ist wohl auf das NetzDG zurückzuführen", sagte er dem #Faktenfuchs.

Die Content-Moderation ist für die großen Plattformen eine Gratwanderung: Nicht nur wegen der Menge der Inhalte, sondern auch wegen der Löschkriterien. Löschen die Netzwerke zu viele Inhalte, ist von Overblocking die Rede. Lassen sie zu viele strittige, möglicherweise strafrechtlich relevante Inhalte stehen, wird das auch kritisiert.

So kommt ein gemeinsamer Bericht der NGOs Hate Aid, einer Beratungsstelle für Betroffene von digitaler Gewalt, und Reset, einer Initiative, die sich für digitale Demokratie einsetzt, zu dem Schluss, dass Facebook gerade jetzt vor der Bundestagswahl bei der Bekämpfung von Hate Speech versage. "Facebook geht selbst dann nur unzureichend gegen offensichtlich rechtswidrige Inhalte vor, wenn diese durch Nutzer:innen gemeldet werden", heißt es in dem Bericht. Die beiden NGOs haben 100 offensichtlich rechtswidrige Kommentare auf öffentlichen Facebook-Seiten der AfD als Verstoß gegen das NetzDG gemeldet. In 33 Fällen habe Facebook keinen Verstoß festgestellt, die Kommentare also online gelassen. In 67 Fällen seien die Kommentare mit Verweisen auf die eigenen Inhaltsrichtlinien gelöscht worden, aber nicht nach dem NetzDG.

Schon von Anfang an mussten die Netzwerke ihre Lösch-Entscheidung begründen. Seit dem 1. Juli 2021 gibt das NetzDG Nutzern auch die Möglichkeit, eine solche Entscheidung im Rahmen eines sogenannten "Gegenvorstellungsverfahrens" anzufechten. Nutzer haben also die Möglichkeit, gezielt gegen Löschungen vorzugehen, die ihrer Ansicht nach ihre Meinungsfreiheit beeinträchtigen.

Marc Liesching erwartet davon jedoch keinen großen Effekt: "Ich glaube, dass die Motivation von Menschen, dieses Gegenvorstellungsverfahren zu machen, wegen eines einzelnen Tweets oder wegen einzelner Äußerungen, die sie getätigt haben, marginal ist", wie er dem #Faktenfuchs sagt.

Manchmal gehen Netzwerke aber noch weiter und sperren ganze Accounts, in der Regel dann, wenn diese mehrmals gegen die Richtlinien verstoßen haben – und nach vorheriger Mahnung. Das wird als "Deplatforming" bezeichnet. Am prominentesten ist der Fall des ehemaligen US-Präsidenten Donald Trump, den sowohl Facebook als auch Twitter von ihren Plattformen verbannt haben. Auch YouTube hat in den letzten beiden Jahren eine Reihe von Accounts gelöscht, die laut eigener Darstellung wiederholt gegen die Community-Richtlinien verstoßen haben. Teilweise wegen Hassrede (Attila Hildmann, Martin Sellner), teilweise, weil sie falsche oder gefährliche Informationen zu Covid19 verbreitet hätten (Ken Jebsen, Querdenken711).

Mitte September hat Facebook ein Netzwerk von knapp 150 Facebook- und Instagram-Konten, Seiten und Gruppen, die es der Querdenken-Bewegung zuordnet, gelöscht. Außerdem hat Facebook Verlinkungen auf Domains der Querdenken-Bewegung entfernt.

Das Querdenker-Netzwerk habe "in koordinierter Weise wiederholt" gegen die Gemeinschaftsstandards verstoßen, heißt es in der Facebook-Pressemitteilung. Hierzu zählten die Veröffentlichung von gesundheitsbezogenen Falschinformationen, Hassrede und Anstiftung zur Gewalt.

Die vom Querdenken-Netzwerk verbreiteten Inhalte hätten das Potenzial, "in reale Gewalt umzuschlagen und auch in anderer Form gesellschaftlichen Schaden anzurichten", schrieb Facebook auf seinem Blog zur Begründung.

"Hier ist Facebook vorgeprescht und hat Sachen entfernt, ohne dass es dafür eine gesetzliche Notwendigkeit in jedem Fall dafür gab", sagt IT-Anwalt Chan-Jo Jun zu dem Fall. Medienrechts-Professor Liesching sieht generell in der Löschung von Accounts einen "massiven Eingriff, der noch weitergeht, als nur einen einzelnen Beitrag zu löschen", wie er dem #Faktenfuchs sagt. Er verweist in diesem Zusammenhang auf das Facebook-Urteil des Bundesgerichtshofes von Ende Juli. Der BGH machte dem Netzwerk Auflagen, wie es Verstöße gegen seine Nutzungsbedingungen ahnden darf – und wie nicht. So muss Facebook Nutzerinnen und Nutzer nachträglich informieren, wenn es einen ihrer Beiträge von der Seite entfernt. Will die Plattform einen Account sperren, muss es vor der Sperre darauf hinweisen und dem User die Möglichkeit geben, sich zu erklären. Unklar ist, ob Facebook das bei der jüngsten Löschung der 150 Querdenken-Accounts getan hat.

Fazit

Die Plattformbetreiber löschen mehr Inhalte als sie eigentlich laut den rechtlichen Vorgaben etwa bei strafrechtlich relevanten Inhalten müssten. Experten machen dafür das NetzDG verantwortlich, das hohe Geldstrafen vorsieht, wenn rechtswidrige Inhalte nicht innerhalb der vorgegeben Frist von 24 Stunden bzw. 7 Tagen entfernt werden. Das daraus resultierende "Overblocking" sei aber problematisch, weil dadurch die Meinungsfreiheit eingeschränkt werde, sagen sowohl der IT-Anwalt Chan Jo-Jun als auch der Medienrechts-Professor Marc Liesching.

Was Zensur eigentlich bedeutet und wie es insgesamt um die freie Meinungsäußerung in Deutschland steht, hat der #Faktenfuchs in Teil 1 der Recherche geklärt.

"Hier ist Bayern": Der BR24 Newsletter informiert Sie immer montags bis freitags zum Feierabend über das Wichtigste vom Tag auf einen Blick – kompakt und direkt in Ihrem privaten Postfach. Hier geht’s zur Anmeldung!