Selbstfahrende Autos Wer darf leben, wer muss sterben?

Die Bremsen versagen. Der Computer im selbstfahrenden Auto hat die Wahl: Familie im Auto schützen und Obdachlose auf der Straße umfahren, oder anders rum? Tote gibt's in jedem Fall. Ein Browser-Game bringt uns in die Bredouille.

Sie sind die Zukunft des Straßenverkehrs: Autos, die ganz von allein fahren, selbst einparken, die richtige Geschwindigkeit kennen und immer den schnellsten Weg finden, auch wenn es Stau oder Baustellen gibt. Mit dieser revolutionären Vorstellung verbinden sich aber auch heftige Gefahren. Computer entscheiden dann im Notfall, wen sie umfahren und wen nicht. Dazu gibt es jetzt ein Browser-Spiel vom MIT, dem Massachusetts Institut for Technology, das dieses üble Dilemma klar macht: die Moral Machine.

Familie im Auto schützen oder Karre gegen die Wand fahren

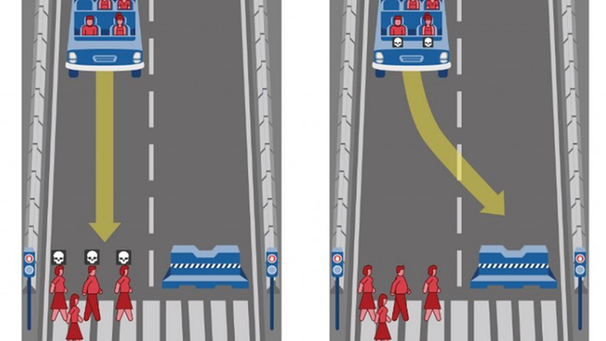

Die Moral Machine ist ein Spiel, das uns zum selbstfahrenden Auto macht. Es simuliert verschiedene Ernstfälle. Ein Beispiel ist: Familie im Auto schützen und Obdachlose umfahren, oder die Obdachlosen am Straßenrand schützen und die Familie gegen die Wand setzen? Die Moral Machine fordert den Spieler auf zu entscheiden. Nach wenigen Klicks ist die Laune am Boden und die Moral passé. Alte gegen Kinder, Obdachlose gegen Ärzte, Athleten gegen Hunde und immer dieselbe Frage: Wer darf leben, wer muss sterben?

Computer kennen keine Moral

Bald ist das kein Spiel mehr, nämlich dann, wenn selbstfahrende Autos vermehrt auf unseren Straßen rumfahren. Selbstfahrende Autos sind zwar High-Tech-Computer - eine Moral, wie wir sie als Menschen haben, können Programmierer trotzdem nicht in einer Software festschreiben. Sie nehmen uns das Fahren ab und können so zum Beispiel die Umwelt schützen, weil sie besonders sparsam fahren, oder blitzschnell die cleverste Route haben, um einen Stau zu vermeiden. Sie fahren nicht im Schritttempo an Unfällen vorbei und versperren so Rettungskräften den Weg oder verursachen kilometerlange Staus.

Aber auch für Computer gibt es den Ernstfall: Die Bremsen versagen, der Computer stürzt ab, oder etwas völlig unvorhersehbares passiert. Und dann muss ein Leben gegen das andere abgewogen werden - und zwar schnell: Familie oder Obdachlose? Wer darf Leben, wer muss sterben? Eine Frage der Programmierung. Die Moral Machine macht genau das deutlich. Sie zeigt, wie kompliziert die Entwicklung von selbstfahrenden Autos ist, und was sie für Folgen für unseren Alltag haben kann. Zum Glück haben Computer keine Gefühle, bei diesen Entscheidungen braucht man ein dickes Fell.

Die Vision Zero

"Alles kein Problem", sagen die Programmierer und Entwickler in den Forschungsabteilungen und träumen von der "Vision Zero" – einer Welt ohne Autounfälle. Sie haben sich vorgenommen, die Autos so zu bauen, dass es nie wieder auch nur einen Unfall gibt.

Damit gehen sie der philosophischen Diskussion aus dem Weg und haben sich einen enormen Berg Arbeit aufgehalst. Wer kann schon garantieren, dass ein Computer immer richtig funktioniert?

Das Prinzip der Doppelwirkung

Die Philosophen sehen darin allerdings ein großes Problem. Denn dahinter steht schließlich die Frage: Welches Leben ist mehr wert? Obwohl sie schon lange darüber nachdenken, haben sie bis jetzt noch keine Lösung gefunden.

Möglichkeiten gibt es genug: Eine Möglichkeit, im Ernstfall moralisch der Zwickmühle zu entkommen, ist das Prinzip der Doppelwirkung: Wenn eine Entscheidung gute und schlechte Folgen hat, und die schlechten nicht beabsichtigt waren, dann geht die Entscheidung klar. Das Auto könnte also eine Person umfahren, weil es einer Familie ausweicht. Der Tod des Einzelnen war nicht beabsichtigt. Das wäre moralisch in Ordnung, hilft den Hinterbliebenen aber wenig und kann eigentlich auch keine Lösung sein.

Das Browser-Game vom MIT ist eine Art Gedanken-Experiment wie es noch viele geben wird, bis Programmierer und Philosophen sich geeinigt haben, wer im Ernstfall leben darf und wer sterben muss. Bis Straßenverkehrsteilnehmer cool damit sind, dass Computer bestimmen, wie viel Wert ihr Leben ist, vergeht hoffentlich noch eine ganze Weile. Oder die Ingenieure schaffen wirklich einen Coup und verwirklichen den Traum von der "Vision Zero" – einer Welt ganz ohne Verkehrsunfälle.

Sendung: Freundeskreis, 05.07.2017 ab 10 Uhr